| 제목 | [산업분석] 생성형 인공지능 보안 위협과 산업별 대응 전략 |

|---|

| 분류 | 성장동력산업 | 판매자 | 국준아 | 조회수 | 159 | |

|---|---|---|---|---|---|---|

| 용량 | 886.45KB | 필요한 K-데이터 | 8도토리 |

| 파일 이름 | 용량 | 잔여일 | 잔여횟수 | 상태 | 다운로드 |

|---|---|---|---|---|---|

| 886.45KB | - | - | - | 다운로드 |

| 데이터날짜 : | 2025-09-17 |

|---|---|

| 출처 : | 국책연구원 |

| 페이지 수 : | 15 |

I. 서론

인공지능(Artificial Intelligence: AI)의 급격한 발전과 함께 LLM(Large Language Model) 기반의 생성형 AI(Generative AI: GenAI)는 기술혁신을 넘어 산업 전반의 패러다임을 변화시켰다.

ChatGPT, Claude, Gemini, Grok 등 대화형 AI 모델이 일상생활과 업무 환경에 도입되면서 콘텐츠, 이미지, 코드 등 생산성 향상을

견인하며 새로운 비즈니스 모델을 창출했다. 생성형 AI는 기술이나 산업 혁신과 더불어 심각한 보안 위협을 동반하고 있다.

대규모 데이터 학습을 통해 생성형 AI 모델을 생성하는 구조적 특성상 학습에 활용된 개인정보 노출 위험은 과거에도 다양한

윤리적 이슈를 유발시켰다.

AI 생태계의 스푸트니크 모멘트(sputnik moment)로 주목받은 DeepSeek은 출시 초기에 다른 프론티어 모델보다 악성 코드 생성이나 익스플로잇(Exploit) 등 ‘나쁜 탈옥’ (Evil Jailbreak) 사례가 다수 발견되었다.

이와 함께 LLM을 통한 악의적인 콘텐츠 생성을 막는 가드레일(guardrail) 우회 기법이 다수 확인되고 있다.

‘나쁜 리커트 판사’(Bad Likert Judge), ‘크레센도’(Crescendo), ‘디셉티브 딜라이트’(Deceptive Delight)를 통해 가드 레일의

우회 가능성이 입증되었다. 생성형 AI 시스템의 방어 메커니즘 무력화는 맥락(context)을 조작하기 때문에

AI 기반 에코시스템의 보안 내재화가 요구된다

II. 생성형 AI 보안 위협 및 공격기법

1. 생성형 AI 환경에서 발생하는 보안 위협

생성형 AI를 적용한 애플리케이션은 기존의 보안 위협 이외에도 생성형 AI로 인한 새로운 보안 위협이 발생한다.

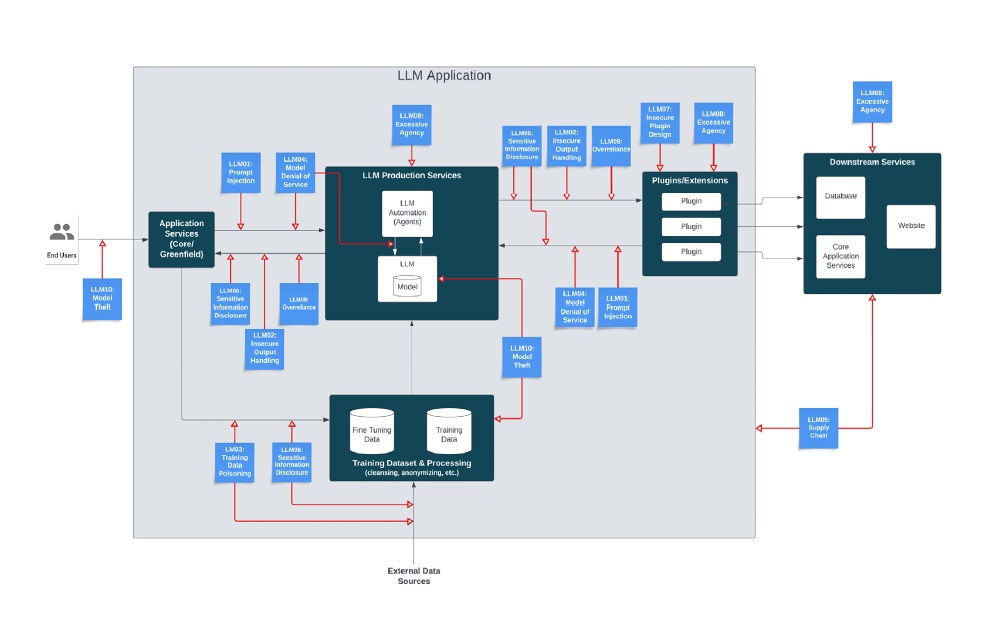

국제적인 비영리 단체인 OWASP(Open Worldwide Application Security Project)에서 발표한 ‘OWASP Top 10 for LLM Applications 2025’를 통해서 생성형 AI의 근간인 LLM 기반 시스템 환경의 보안 위협을 살펴본다

LLM 모델 학습에 사용되는 데이터와 처리 과정인 ‘학습 데이터셋 및 처리’(Training Dataset & Processing)와 데이터 소스인 외부

데이터가 연계된다. 수집된 데이터는 LLM 모델을 실제로 운영하는 핵심 서비스인 ‘LLM 프로덕션 서비스’(LLM Production Service)에서 LLM 추론(inference) 엔진과 모델로 운영된다. 생성된 LLM 서비스를 외부 시스템과 연동 및 확장을 위한

‘플러그인/확장’(plugins/extensions) 기능을 거쳐 LLM 애플리케이션의 결과를 전달하는 외부 채널인

‘다운스트림 서비스’(downstream services)로 이어진다.

---------------------------------------------------------------------------------------------------------------------------------------------------------

※ 본 서비스에서 제공되는 각 저작물의 저작권은 자료제공사에 있으며 각 저작물의 견해와 DATA 365와는 견해가 다를 수 있습니다.