| 제목 | [산업분석] 2025년 대한민국 공공 파운데이션 모델 구축 및 활용 전략 |

|---|

| 분류 | 성장동력산업 | 판매자 | 정한솔 | 조회수 | 189 | |

|---|---|---|---|---|---|---|

| 용량 | 1.87MB | 필요한 K-데이터 | 13도토리 |

| 파일 이름 | 용량 | 잔여일 | 잔여횟수 | 상태 | 다운로드 |

|---|---|---|---|---|---|

| 1.87MB | - | - | - | 다운로드 |

| 데이터날짜 : | 2025-06-09 |

|---|---|

| 출처 : | 국책연구원 |

| 페이지 수 : | 72 |

Ⅰ. 필요성(Need)

지속적인 개방형 LLM 신기술의 도래

○ (개방형 기술 혁신의 부상) 최근 대형언어모델(LLM) 분야에서는 GPT-4, Claude 등 폐쇄형 모델뿐 아니라,

DeepSeek, LLaMA, EXAONE, HyperCLOVA X 등 고성능 오픈소스 모델들이 지속적으로 등장하며 기술 혁신이

가속화되고 있음

- (DeepSeek 모델) 중국의 DeepSeek는 2025년 1월 자체 개발한 DeepSeek-R1 모델을 공개하며, 기존 거대 기술기업 수준의 성능 을 훨씬 낮은 비용으로 구현해 주목받음. 해당 모델은 오픈소스로 공개되어 누구나 무료로 사용할 수 있으며, 출시 며칠 만에 이를

탑재한 챗봇 앱이 애플 앱스토어 1위를 기록하며 ChatGPT를 능가함

- (Meta의 LLaMA 3.1 공개) 2025년 Meta는 LLaMA 3.1~4 시리즈를 통해 성능과 효율성을 모두 개선한 모델을 공개.

특히 405B 매개변수 모델은 OpenAI GPT-4 및 Anthropic Claude 3와의 비교 평가에서 동등한 수준의 성능을 보이며,

자유롭게 접근 가능한 고성능 오픈소스 LLM의 대표주자로 부상[5]

- (Mistral의 Mixtral 모델) 프랑스 스타트업 Mistral은 MoE(Mixture of Experts) 기반의 고성능 모델인 Mixtral 8x7B를 공개.

일부 전문가만 활성화하는 구조를 통해 연산 비용을 줄이면서도 높은 성능을 유지해 기업 및 학계에서 빠르게 도입 중

- (LG의 EXAONE-3) LG AI 연구원은 2025년 EXAONE-3를 공개, 한글 기반 성능 강화 및 텍스트-이미지 통합 처리 능력을 확보,

제조·헬스케어 등 산업 특화형 AI 서비스로 확장하며, 일부 모듈은 오픈소스로 공개하여 협력 기반 생태계 구축 추진

- (NAVER의 HyperCLOVA X 경량버전 공개) NAVER는 2025년 HyperCLOVA X의 경량화 버전을 오픈소스로 공개하여

중소기업과 공공기관의 LLM 활용 장벽을 낮춤. 특히 한국어 및 다국어 대응 성능이 높아 AI 서비스의 국산화·자립에 기여하는

사례로 평가됨

아키텍처 및 모델

LLM 통합 시스템을 위한 소프트웨어 기능 참조 아키텍처

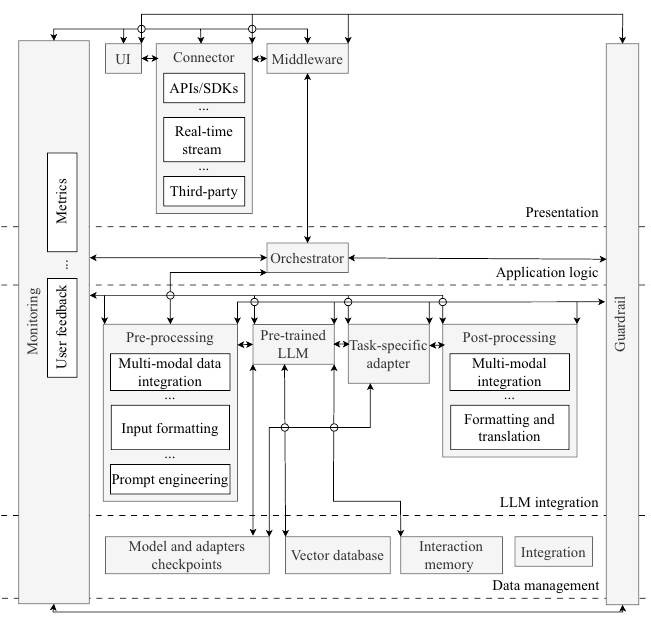

○ Alessio Bucaioni et al.(2025)은 “A Functional Software Reference Architecture for LLM-Integrated Systems”에서

개인정보보호, 보안, 모듈성, 상호운용성 등을 해결하기 위한 소프트웨어 설계 및 품질 속성 기반 참조 아키텍처를 제시함

○ 해당 참조 아키텍처에서는 프리젠테이션, 응용로직, LLM 통합, 데이터 관리 4개의 계층으로 이루어져 있으며,

구성요소가 상자로 표현되고 있으며 모니터링과 가드레일이 여러 계층에 걸쳐 존재함

---------------------------------------------------------------------------------------------------------------------------------------------------------

※ 본 서비스에서 제공되는 각 저작물의 저작권은 자료제공사에 있으며 각 저작물의 견해와 DATA 365와는 견해가 다를 수 있습니다.